Sora, Model Text-to-Video Terbaru OpenAI yang Memukau Dunia!

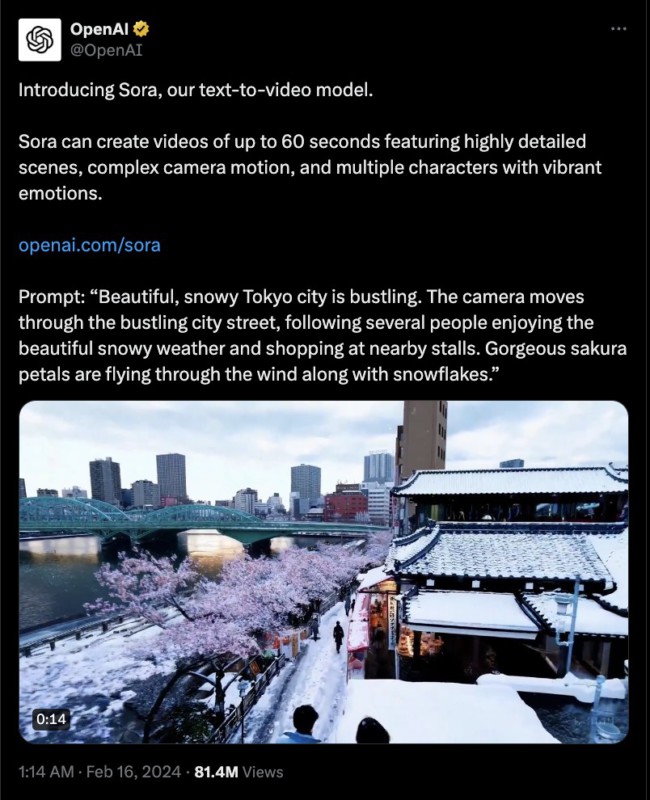

OpenAI, perusahaan kecerdasan buatan terkemuka, baru saja memperkenalkan model text-to-video pertamanya yang diberi nama Sora. Model ini mampu menciptakan video mendetail dari teks sederhana, melanjutkan video yang ada, dan bahkan menghasilkan adegan berdasarkan gambar diam. Sora telah menjadi perbincangan hangat di media sosial dan menuai pujian dari para ahli. Simak berita lengkapnya berikut ini!

Kemampuan dan Kelemahan Sora

Sora beroperasi menggunakan model difusi, yang secara bertahap mengubah “kebisingan statis” menjadi video atau gambar yang jelas. Model ini dibangun berdasarkan penelitian sebelumnya dari model ChatGPT dan Dall-E 3, sehingga mampu menghasilkan video yang lebih akurat dan sesuai dengan masukan pengguna.

Sora dapat menghasilkan adegan seperti film dengan resolusi hingga 1080p, menampilkan beberapa karakter, jenis gerakan tertentu, dan detail subjek dan latar belakang yang akurat.

Meskipun Sora memiliki kemampuan yang luar biasa, OpenAI mengakui bahwa model ini masih memiliki beberapa kelemahan. Salah satunya adalah kesulitan dalam mensimulasikan fisika adegan yang kompleks secara akurat, seperti mengacaukan hubungan sebab dan akibat. Sora juga dapat mengalami kesulitan dalam memahami “detail spasial” dari suatu perintah, seperti mencampur kiri dan kanan atau gagal mengikuti deskripsi arah yang tepat.

Baca Juga: FTC Bersiap Menindak Perusahaan yang Menggunakan AI untuk Peniruan Identitas!

Potensi Penyalahgunaan Sora

Kemajuan teknologi AI telah menjadi bahan bakar bagi para penipu, dan Sora dikhawatirkan dapat disalahgunakan untuk melakukan penipuan kripto. Penipu dapat menggunakan Sora untuk membuat deepfake yang menyamar sebagai orang atau perusahaan sungguhan untuk mempromosikan proyek kripto palsu. Mereka juga dapat menggunakan Sora untuk menghasilkan dukungan selebritas palsu untuk proyek web3 dan kripto.

Baca Juga: RUU ELVIS Melindungi Musisi Tennessee dari Penyalahgunaan AI

Langkah Keamanan OpenAI

OpenAI menyadari potensi penyalahgunaan Sora dan telah mengambil beberapa langkah keamanan sebelum merilis model ini secara luas. Perusahaan bekerja sama dengan “red teamer”, pakar keamanan siber, untuk menguji model secara adversarial dan mengidentifikasi potensi bahaya atau risiko.

OpenAI juga akan menerapkan klasifikasi teks untuk menolak perintah yang melanggar kebijakan mereka, seperti permintaan konten seksual, video kekerasan, dan kemiripan selebritas.

Ikuti kami di Google News untuk mendapatkan berita-berita terbaru seputar crypto. Nyalakan notifikasi agar tidak ketinggalan beritanya.

*Disclaimer

Konten ini bertujuan memperkaya informasi pembaca. Selalu lakukan riset mandiri dan gunakan uang dingin sebelum berinvestasi. Segala aktivitas jual beli dan investasi aset crypto menjadi tanggung jawab pembaca.

Referensi

- Cointelegraph. Sora: OpenAI video generation model and artificial intelligence weakness. Diakses pada tanggal 17 Februari 2024

- BeInCrypto. OpenAI AI text-to-video Sora used in crypto scams. Diakses pada tanggal 17 Februari 2024

- TechRadar. OpenAI’s new Sora text-to-video model can make shockingly realistic content. Diakses pada tanggal 17 Februari 2024

- Featured Image: Capacity Media